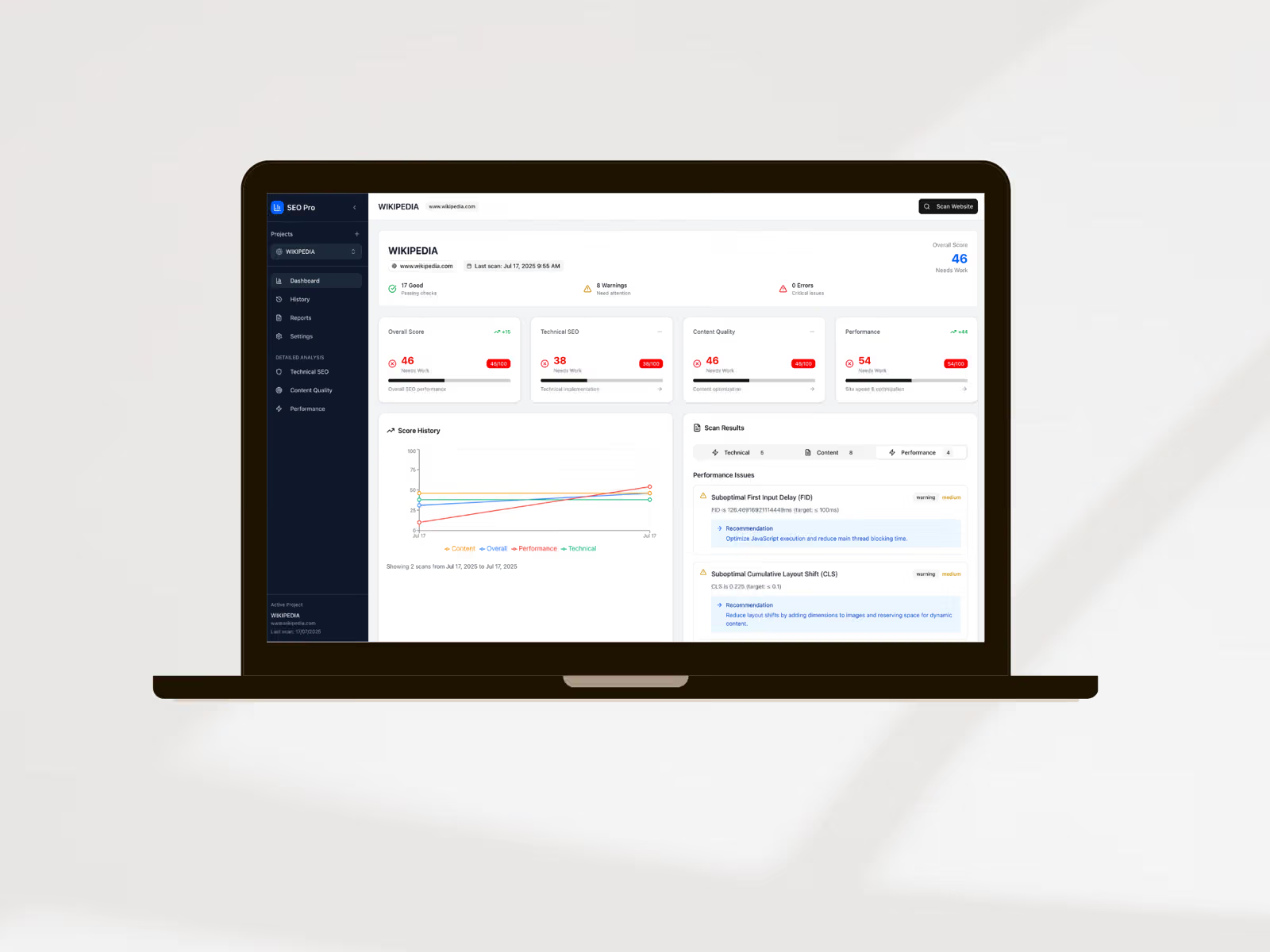

SEO Tool — Technisches SEO mit Echtzeit-Feedback

Der Markt für SEO-Tools ist fragmentiert: Entweder zu technisch, zu oberflächlich oder zu unübersichtlich. Unser Kunde – aus strategischen Gründen nicht öffentlich – beauftragte uns mit der Entwicklung eines eigenen SEO-Tools, das gezielt technische OnPage-Schwachstellen erkennt, bewertet und konkrete Optimierungsschritte vorschlägt.

Die Lösung sollte eigenständig crawlende Mechanismen enthalten, skalierbar sein, ein Dashboard für Performance-Analyse bieten und UX-technisch zugänglicher sein als klassische SEO-Software.

Herausforderung

Die Anforderungen waren hoch, sowohl technisch als auch konzeptionell:

- SEO-Crawling & Bewertung: Domains und Subseiten sollten regelmäßig gescannt, analysiert und bewertet werden – inklusive Lighthouse-ähnlicher KPIs

- Live-Feedback: Nutzer:innen sollten bei Seitenfehlern, Strukturproblemen oder Performance-Issues direkt konkrete Handlungsvorschläge erhalten

- Intuitives UI/UX: Keine SEO-Fachkenntnis nötig – das Tool sollte auch für Redakteure oder Produktverantwortliche verständlich sein

- Modulare Architektur: Um neue Analysemodule (z. B. für Semantik, Ladezeiten, Accessibility) einfach ergänzen zu können

- Mandantenfähigkeit: Mehrere Kunden, Domains & User pro Account verwaltbar – DSGVO-konform

Lösung

Die Umsetzung erfolgte in einem klar strukturierten, modularen Setup – optimiert für Performance und Erweiterbarkeit:

- Frontend mit React/Next.js: Mit shadcn/ui für saubere, elegante Komponenten und einheitliches Designsystem

- Crawler Engine (Node.js): Analysiert DOM-Strukturen, Meta-Daten, Core Web Vitals & technische SEO-Fehler vollautomatisch

- Task-Queue & Scheduler: Steuerung von Crawl-Frequenz, Nachtläufen & Domain-Priorisierung

- SEO-Score System: Bewertet jede Seite mit nachvollziehbarem Punktesystem – inklusive Vergleichshistorie & Alerts bei Verschlechterung

- Empfehlungslogik: Natural Language Templates generieren konkrete, priorisierte Verbesserungsvorschläge pro Seite & Problemtyp

- PostgreSQL & Redis: Für performante Speicherung & schnelles Caching großer Crawling-Datenmengen

- Mandantenfähiges Dashboard: Verwaltung von Domains, Usern, Reports & Prioritäten – mit granularen Rechten

Die klare Trennung von Crawler, Analyse-Engine, API und Frontend ermöglicht zukünftig auch API-Only Nutzung, z. B. für Headless CMS oder externe BI-Tools.

Ergebnis

Das Tool wurde innerhalb weniger Monate erfolgreich implementiert und produktiv gesetzt:

- Mehr als 2.000 Seiten gecrawlt im ersten Monat

- 95 % Nutzeraktivität nach der ersten Empfehlungsausspielung

- Reduktion der technischen SEO-Fehler um Ø 63% bei Pilotkunden

- DSGVO-konforme Multi-Account-Verwaltung für internationale Rollouts vorbereitet

Die Plattform hebt sich nicht nur durch technische Tiefe ab, sondern vor allem durch die klare, verständliche Nutzerführung – und spart internen SEO-Teams enorm viel Zeit.